Récupération Du Contenu Textuel (DUMP)

On avance, on avance...

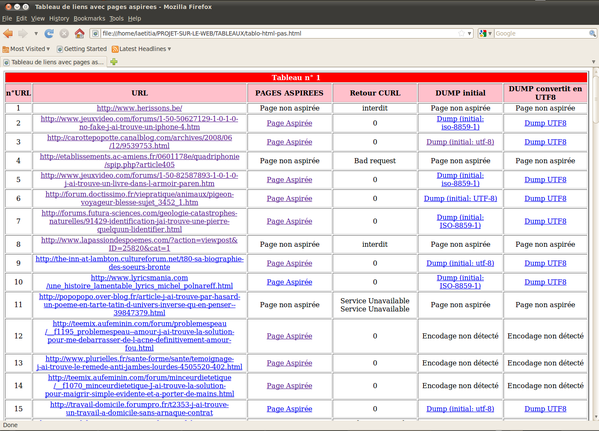

Notre tableau de lien s'etoffe encore cette semaine. En effet nous devions rajouter le contenu textuel de nos pages aspirées (les dumps) dans leur encodage d'origine dans une première colonne, puis convertit en utf8 dans une seconde colonne.

Le tout en ayant au préalable ésolu le problème de notre retourcurl qui n'indique aucune erreur alors que certaines pages aspirées sont blanches....

Du boulot donc!

Le problème de nos pages blanches venait du fait que curl récuperait des pages dont l'accès est interdit. En effet, il n'y a pas derreur pour la commande qui récupère bien un contenu (mais pas du tout ce que l'on veut...)

Il nous faut donc nous assuer dan notre script de vérifier que les pages aspirées ne sont pas des pages d'erreur (si c'est le cas le traitement automatique s'arrete pour elles...)

De plus, il va falloir que nous "dumpions" les pages aspirées exploitables pour la suite de notre travail grace otamment à la commande lynx, mais le tout en s'assurant que la page est encodée en utf8!

Si ce n'est pas le cas, nous allons devoir trouver quel est l'encodage de la page problématique, et si l'encodage est reconnu par la commande iconv, nous devrons les convertir en utf8.

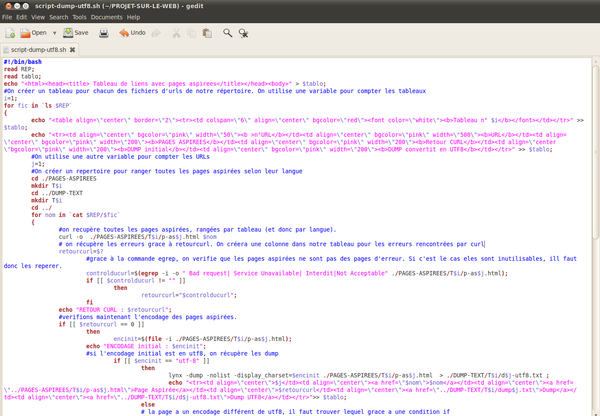

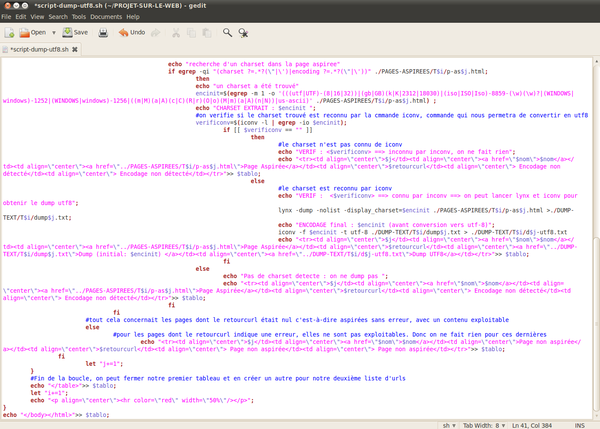

Donc, traitement auomatique "en veux-tu? en voila! ", avec ce script (bien dense) :

On lance le tout, et voila le résultat :

On peut voir que le programme a bien fonctionné! On a tout ce qu'il faut, là où il faut.

Cependant, dans la colonne retoucurl, parfois l'erreur est ecrite plusieurs fois (ex: tableau1, urls 11 et 16) je n'ai pas compris pourquoi...

On remarque également que d'autres pertes d'urls sont à déplorer, réduisant encore notre corpus.

Mais nous progressons dans l'avancée du projet!

To be continued...

Lintia